Avant d’explorer les solutions concrètes qui permettent de reconquérir notre autonomie numérique, prenons le temps de comprendre les principes fondamentaux qui définissent une véritable souveraineté des données. Ces piliers ne sont pas de simples détails techniques, ils constituent les fondations d’un internet où l’utilisateur reste maître de ses informations.

Ce que vous allez voir

💻️ Les conditions techniques

- Le chiffrement de bout en bout

- Le traitement des métadonnées

- L’Open Source

- Décentralisation etauto-hébergement

🏛️Des solutions politiques et juridiques ?

- Le RGPD : Un texte fondateur dans la protection des données

- La loi SREN : le cloud souverain avant tout

- L’AI Act: réguler l’Intelligence Artificielle

- Le Cyber Resilience Act : renforcer la résilience des produits connectés

- Plusieurs textes pour encadrer le secteur

🛠️Les défis

- La concentration du pouvoir technologique

- Des plateformes moins intuitives

- L’effet réseau

- Des business modèles à éprouver

- L’inertie de l’habitude

💻️Les conditions techniques

1. Le chiffrement de bout en bout

On l’a déjà évoqué dans ce module, le chiffrement de bout en bout (End-to-End Encryption ou E2EE en anglais) signifie que vos données sont transformées en un code illisible dès qu’elles quittent votre appareil, et ne redeviennent lisibles qu’une fois arrivées chez le destinataire. Entre ces deux points, personne, ni votre fournisseur d’accès internet, ni la plateforme que vous utilisez, ni même un pirate informatique qui intercepterait vos communications, ne peut déchiffrer le contenu. Le seul à disposer de la clé déchiffrement est le destinataire du message. A l’heure actuelle cette solution demeure l’assurance ultime que vos échanges restent véritablement privés.

Pourquoi est-ce si important ? Parce que sans chiffrement de bout en bout, vos données transitent « en clair » ou semi-protégées sur les serveurs intermédiaires. L’entreprise qui gère ces serveurs détient les clés de déchiffrement et peut théoriquement accéder à vos fichiers. C’est exactement le cas avec Google Drive, comme nous l’avons vu : techniquement sécurisé contre les pirates externes, mais transparent pour Google lui-même.

Nous aurons l’occasion de vous présenter, plus tard dans cette section, des services comme Signal pour la messagerie ou ProtonDrive pour le stockage implémentant le chiffrement de bout en bout par défaut. Même si leurs serveurs étaient compromis ou saisis par une autorité, vos communications resteraient illisibles. C’est cette garantie technique qui fait toute la différence entre « avoir confiance dans une entreprise » et « ne pas avoir besoin de lui faire confiance ».

Dans le même temps, il est important de garder en tête que le chiffrement de bout en bout n’est pas une baguette magique qui protège de facto vos données. L’attaque contre le gestionnaire de mots de passe LastPass en 2022, l’a bien montré : toutes les données n’étaient pas chiffrées de la même façon, certaines métadonnées restaient exposées, et l’ensemble des coffres chiffrés a été volé. À partir de là, toute la sécurité reposait sur un seul élément : la solidité du mot de passe maître choisi par chaque utilisateur.

Autrement dit, même avec du chiffrement de bout en bout, une architecture qui dépend d’un mot de passe unique et fragile reste vulnérable. Cet exemple rappelle que la protection réelle de vos données repose à la fois sur de bons outils et sur la manière dont ils sont conçus et utilisés (qualité du mot de passe, éventuellement clé matérielle, limitation des métadonnées exposées), pas uniquement sur la présence du label « E2EE » sur la fiche produit.

2. Le traitement des métadonnées

Si le contenu de vos communications est important, les métadonnées qui les accompagnent le sont tout autant. Les métadonnées sont toutes les informations sur vos données plutôt que leur contenu direct : qui communique avec qui, à quelle heure, depuis quel endroit, pendant combien de temps, à quelle fréquence.

Prenons un exemple concret. Vous pouvez chiffrer de bout en bout tous vos messages avec votre médecin, mais si les métadonnées révèlent que vous échangez avec lui tous les mardis à 14h depuis trois mois, puis que vous contactez soudainement un oncologue réputé, ces simples données de connexion racontent une histoire que vous préféreriez peut-être garder privée. De même, savoir qu’un journaliste contacte fréquemment une source au sein d’un gouvernement peut suffire à identifier cette source, même si le contenu des messages reste secret.

Les agences de renseignement l’ont bien compris. L’ancien directeur de la NSA, Michael Hayden, a déclaré publiquement : « Nous tuons des gens sur la base de métadonnées ». Cette phrase, qui s’inscrit dans un cas extrême, illustre à quel point ces informations apparemment anodines peuvent être redoutablement précises pour tracer les habitudes, les relations sociales, les déplacements et même les intentions d’une personne.

Un outil véritablement souverain doit donc minimiser, voire éliminer, la collecte de métadonnées.

3. L’Open Source

Comment savoir si un logiciel respecte réellement ses promesses de sécurité et de confidentialité ? Comment être certain qu’il ne contient pas de porte dérobée permettant à son créateur ou à un gouvernement d’accéder discrètement à vos données ? La réponse tient en deux mots : code ouvert (open source).

Un logiciel open source est un logiciel dont le code source, c’est-à-dire l’ensemble des instructions qui le font fonctionner, est publiquement accessible. N’importe quel développeur, chercheur en sécurité ou expert indépendant peut l’examiner, l’auditer, vérifier qu’il fait exactement ce qu’il prétend faire, et rien d’autre. C’est l’équivalent numérique d’une cuisine ouverte dans un restaurant : vous pouvez voir comment votre plat est préparé, quels ingrédients sont utilisés, dans quelles conditions d’hygiène.

Un principe qui ne garantit pas l’absence de vulnérabilités mais qui élimine la nécessité de faire aveuglément confiance à une entreprise. Vous n’avez pas besoin de croire sur parole qu’un logiciel est sécurisé, vous pouvez le vérifier par vous-même, ou vous appuyer sur la communauté mondiale d’experts qui l’a déjà fait. Cette approche collaborative de la sécurité a fait ses preuves : des systèmes comme Linux, qui alimentent la majorité des serveurs mondiaux, reposent sur du code ouvert et sont considérés comme parmi les plus sûrs au monde.

À l’inverse, les logiciels propriétaires comme ceux de Microsoft, Google ou Apple fonctionnent dans l’opacité. Leur code est secret, protégé comme une recette industrielle confidentielle. Peut-être sont-ils parfaitement sécurisés. Peut-être contiennent-ils des vulnérabilités inconnues, ou des mécanismes de surveillance intégrés. Impossible de le savoir avec certitude. C’est une question de confiance aveugle plutôt que de vérification transparente.

Le logiciel libre est également un pilier de la souveraineté numérique collective. En supportant des projets open source, vous investissez dans un écosystème numérique plus transparent, plus démocratique, et moins dépendant du bon vouloir de quelques géants technologiques. C’est un choix qui dépasse la simple question technique pour toucher à des valeurs politiques et éthiques fondamentales.

Mais cette notion est à aborder avec nuances, car open source ne veut pas dire souverain par nature. En matière de logiciels, tout dépend donc aussi de la gouvernance : qui contrôle réellement le projet, qui décide des orientations, qui finance, et que se passe‑t‑il si cet acteur change de stratégie ou disparaît.

On peut grossièrement distinguer trois grandes familles de modèles :

- Les modèles « fondation » : le code est porté par une fondation à but non lucratif, avec une gouvernance partagée. Dans ce modèle, aucune entreprise unique ne peut racheter le projet ou en verrouiller l’évolution ; si un contributeur majeur se retire, le projet peut continuer à vivre avec d’autres acteurs.

- Les modèles « single‑vendor » : le logiciel est open source, mais piloté et financé par une entreprise unique. Tant que la stratégie de l’entreprise reste alignée avec les valeurs du projet, tout va bien ; mais un rachat, une pression d’investisseurs ou un changement de licence peuvent fragiliser la souveraineté du logiciel, même si le code reste accessible. Le fait de pouvoir forker le projet (comme Vaultwarden à partir de Bitwarden) est alors une bouée de secours, mais pas une garantie absolue d’écosystème viable à long terme.

- Les modèles publics / étatiques : La souveraineté y est forte sur le plan national (le code et l’infrastructure sont sous contrôle public), mais la pérennité dépend de décisions politiques et budgétaires, plus que d’une dynamique communautaire.

4. Décentralisation et auto-hébergement

Les systèmes centralisés présentent un défaut structurel majeur : ils créent des points de faiblesse uniques. Lorsque toutes vos données sont stockées au même endroit, contrôlées par une seule entité, celle-ci devient de facto une cible privilégiée. Un piratage, une panne technique, un changement de politique commerciale et voilà l’intégralité de vos informations et de vos outils potentiellement compromis, inaccessibles ou exposés.

Les solutions décentralisées adoptent une philosophie radicalement différente. Au lieu de concentrer les données sur quelques serveurs géants appartenant à une entreprise, elles les répartissent sur un réseau distribué d’ordinateurs indépendants. C’est le principe du peer-to-peer (pair-à-pair), où chaque participant devient à la fois client et serveur.

L’auto-hébergement va encore plus loin dans cette logique d’autonomie. Il consiste à faire tourner ses propres services sur un serveur personnel, chez soi ou loué auprès d’un hébergeur de confiance.

Problème : bien qu’il représente un idéal pour les technophiles, il peut devenir rapidement problématique pour les utilisateurs non initiés. Les barrières techniques à ce type de solution freinent leu démocratisation et la réalité montre que beaucoup de dispositifs d’auto-hébergement (NAS, serveurs personnels) sont mis en ligne sans protection adéquate, exposés directement à Internet en raison d’une mauvaise configuration.

L’’auto-hébergement demande donc un investissement initial en temps et en compétences techniques. Mais il offre un niveau de contrôle et d’indépendance inégalé. Vos données ne transitent plus par les serveurs d’une multinationale soumise au Cloud Act américain. Elles restent physiquement chez vous, sous votre juridiction, inaccessibles aux demandes de gouvernements étrangers. C’est la forme la plus pure de souveraineté numérique individuelle.

🏛️Des solutions politiques et juridiques ?

Face à la domination des géants technologiques américains et à l’émergence de puissances numériques chinoises, l’Union Européenne a pris le pari d’adopter une approche proactive. L’objectif ? Bâtir un cadre réglementaire visant à protéger ses citoyens, et tenter de créer les conditions d’émergence d’une industrie numérique européenne souveraine. Parmi les initiatives, certains textes ont fait figure de bascule dans cette prise de conscience politique.

1. Le RGPD : Un texte fondateur dans la protection des données

En 2016, l’Europe se dote d’un texte qui change la donne : le RGPD. Pour la première fois, une législation impose des normes rigoureuses à toutes les entreprises, même basées en dehors du continent, qui traitent les données de citoyens européens. Peu importe que Facebook ait son siège en Californie ou qu’Amazon stocke ses serveurs en Virginie : s’ils veulent faire des affaires en Europe, ils doivent se plier aux règles européennes. Facebook ait son siège en Californie ou qu’Amazon stocke ses serveurs en Virginie : s’ils veulent faire des affaires en Europe, ils doivent se plier aux règles européennes.

Ce règlement a établi des droits concrets pour les utilisateurs : le droit d’accéder à leurs données, de les corriger, de les supprimer, de les transférer vers un autre service, et d’être informés en cas de violation de sécurité. Il a également imposé des obligations strictes aux entreprises : minimiser la collecte de données, obtenir un consentement clair et explicite, garantir la sécurité des informations, et démontrer leur conformité par des audits réguliers.

Pour les citoyens européens, le cadre juridique constitue une protection essentielle, souvent négligée dans les débats purement techniques. Le Règlement Général sur la Protection des Données (RGPD), entré en vigueur en mai 2018, représente l’une des législations les plus strictes au monde en matière de protection de la vie privée. Ses principes sont clairs : minimisation des données collectées, consentement explicite, droit à l’oubli, portabilité des informations, et obligation pour les entreprises de démontrer leur conformité.

Mais le RGPD ne suffit pas. Il faut également considérer la juridiction sous laquelle opère le service que vous utilisez. Comme nous l’avons vu avec le Patriot Act et le Cloud Act, les entreprises américaines, même lorsqu’elles stockent vos données sur des serveurs européens, restent soumises aux lois américaines et doivent fournir l’accès à vos informations aux autorités fédérales américaines sur simple demande judiciaire.

C’est pourquoi la localisation géographique et juridique de votre fournisseur de services compte. Une entreprise européenne hébergeant ses données en Europe et soumise uniquement au droit européen offre une protection légale bien supérieure.

2. La loi SREN : le cloud souverain avant tout

En mai 2024, la France a franchi une étape supplémentaire avec l’adoption de la loi SREN (Sécuriser et Réguler l’Espace Numérique). Ce texte marque un tournant dans la doctrine française du cloud computing. Désormais, les données sensibles de l’État doivent être hébergées via des infrastructures qualifiées selon le référentiel SecNumCloud, une certification élaborée par l’Agence nationale de la sécurité des systèmes d’information (ANSSI).

Cette qualification SecNumCloud garantit que le fournisseur cloud respecte des critères stricts de sécurité et, surtout, qu’il ne peut être contraint par une législation extraterritoriale, comme le Cloud Act américain, de livrer les données à un gouvernement étranger. C’est une réponse directe aux inquiétudes soulevées par la domination des hyperscalers américains (AWS, Microsoft Azure, Google Cloud Platform) sur le marché européen.

La loi SREN va au-delà en s’attaquant à un problème bien connu : le verrouillage commercial (vendor lock-in). Elle encadre désormais les frais de sortie des fournisseurs cloud, limite à un an la validité des crédits cloud offerts aux entreprises, et impose aux fournisseurs de garantir l’interopérabilité et la portabilité des données. L’objectif est explicitement affiché, il s’agit de « restaurer l’équité commerciale sur le marché du cloud, aujourd’hui concentré dans les mains d’une poignée d’acteurs » en facilitant la migration d’un fournisseur à l’autre, en réduisant la dépendance technique et commerciale, et en créant de facto un marché plus concurrentiel.

Bien sûr, la réalité sur le terrain reste complexe. Début 2024, Microsoft a été choisi pour héberger les données médicales des Français via le Health Data Hub, et EDF a opté pour AWS pour une partie de ses données. Ces décisions ont suscité de vives controverses et illustrent la difficulté pour la France et l’Europe de concilier leurs ambitions de souveraineté avec les réalités économiques et techniques d’un marché dominé par les acteurs américains.

Néanmoins, l’intention politique est claire, et les outils législatifs se mettent progressivement en place.

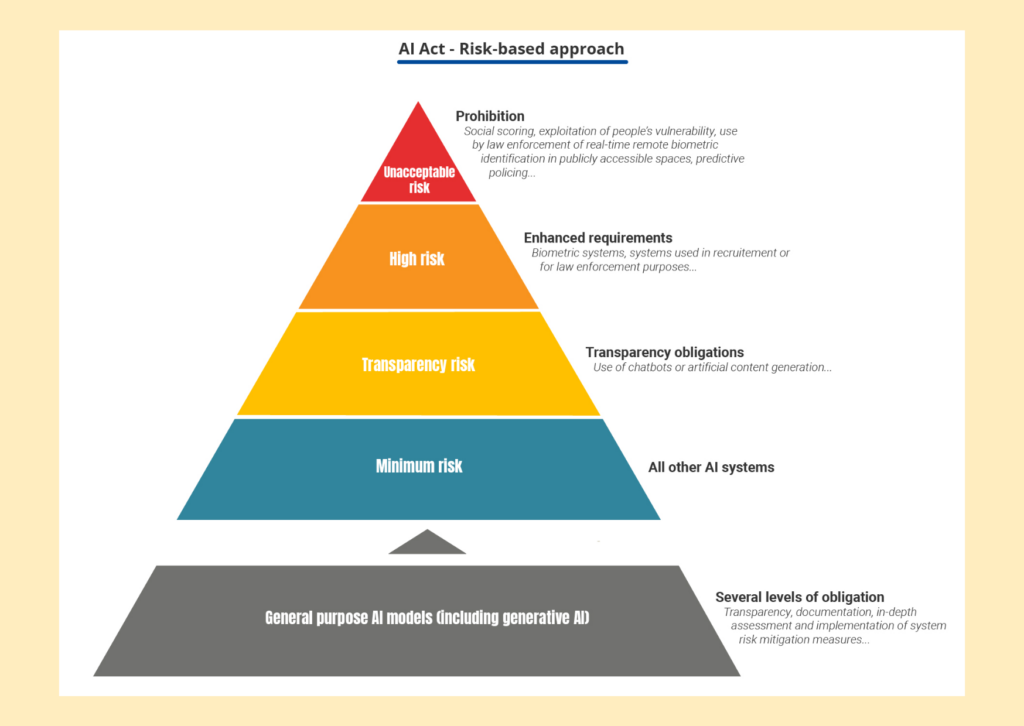

3. L’AI Act : réguler l’Intelligence Artificielle

En 2024, l’Union Européenne a également franchi une nouvelle étape en adoptant le premier cadre législatif régulant l’intelligence artificielle. Le règlement européen sur l’IA (AI Act) est entré en vigueur le 1er août 2024, et son ambition est considérable : encadrer le développement et l’utilisation des systèmes d’IA pour garantir qu’ils respectent les droits fondamentaux, la démocratie et l’État de droit.

L’AI Act adopte une approche fondée sur les risques, classant les systèmes d’IA en quatre catégories principales : risque inacceptable (systèmes interdits comme la notation sociale ou la reconnaissance biométrique de masse), risque élevé (secteurs sensibles comme la santé, l’emploi ou la justice), risque limité (obligation de transparence, comme indiquer qu’un contenu est généré par IA), et risque minimal ou nul.

Source : Le CNIL (2024)

Cette régulation vise un double objectif. D’une part, protéger les citoyens européens contre les dérives potentielles de l’IA : discrimination algorithmique, manipulation comportementale, surveillance de masse, atteintes aux droits fondamentaux. D’autre part, créer un cadre clair permettant aux entreprises européennes de se développer dans un environnement juridique clair et prévisible.

La France a saisi cette opportunité pour renforcer sa souveraineté numérique, en annonçant des investissements de 400 millions d’euros dans neuf clusters d’IA visant à former 100 000 personnes par an dans ce secteur stratégique. L’objectif est clair : ne pas laisser le leadership de l’IA aux seuls géants américains et chinois, mais bâtir une industrie européenne de l’intelligence artificielle, en phase avec la vision du continent.

4. Le Cyber Resilience Act : renforcer la résilience des produits connectés

En parallèle de ces cadres globaux, le Cyber Resilience Act, intègre une notion jusque là absente au niveau européen : la cybersécurité «by design».

Concrètement, ce règlement vise à imposer des standards de cybersécurité strictes à tous les produits numériques mis sur le marché européen, en particulier les objets connectés (IoT). En exigeant des mises à jour de sécurité obligatoires, une divulgation rapide des vulnérabilités, et une documentation technique claire, le CRA adresse un risque majeur : la prolifération de dispositifs non sécurisés exposant les utilisateurs et les infrastructures critiques.

C’est un complément essentiel aux autres régulations, reconnaissant que la souveraineté numérique ne peut se construire que sur des fondations techniquement robustes.

5. Plusieurs textes pour encadrer le secteur

Ces initiatives législatives ne sont pas des textes isolés. Elles s’inscrivent dans une stratégie globale visant à réduire la dépendance technologique de l’Europe, à rassurer ses citoyens, et à créer les conditions d’une industrie numérique européenne compétitive.

Aux textes cités précédemment, on pourra également ajouter le Data Governance Act (DGA) adopté en 2022 et entré en vigueur en 2023. Ce règlement vise à faciliter le partage des données entre entreprises en encourageant notamment la création d’« espaces de données » sectoriels (santé, mobilité, environnement, etc.) où les données peuvent être partagées de manière sécurisée et encadrée. Il régule également les « intermédiaires de données », ces plateformes qui facilitent l’échange d’informations entre acteurs économiques. L’idée est de créer une économie européenne des données plus dynamique, moins dépendante des plateformes américaines, et capable de générer de la valeur tout en respectant le cadre législatif de l’Union.

À travers ces mesures politiques, l’Europe cherche à insuffler un dynamisme souverain et envoi un signal à ses citoyens. En privilégiant des services européens, les utilisateurs peuvent s’inscrire dans un projet collectif de reconquête de l’autonomie numérique.

🛠️Les défis

1. La concentration du pouvoir technologique

Le premier défi tient à la concentration extraordinaire du pouvoir technologique. Une poignée de mégacorporations, dont les fameux GAFAM (Google, Apple, Facebook/Meta, Amazon, Microsoft) auxquels on pourrait ajouter quelques autres géants chinois contrôlent désormais l’essentiel de l’infrastructure numérique mondiale. Cette concentration n’a aucun équivalent historique. Google domine la recherche en ligne avec plus de 90% de parts de marché mondial. Meta contrôle les trois principales applications de messagerie (WhatsApp, Messenger, Instagram). Amazon héberge près d’un tiers de l’internet via AWS. Microsoft équipe l’immense majorité des ordinateurs professionnels. Cette domination crée un cercle vicieux : plus ces entreprises sont utilisées, plus elles accumulent de données, plus leurs algorithmes s’améliorent, plus elles deviennent indispensables, et plus il devient difficile pour les alternatives de rivaliser. Face à ces mastodontes aux ressources quasi illimitées, les petites structures proposant des alternatives éthiques peinent à se faire connaître et à attirer suffisamment d’utilisateurs pour atteindre une masse critique.

2. Des plateformes moins intuitives

Soyons honnêtes : les outils libres et respectueux de la vie privée demandent souvent plus de connaissances et d’efforts que leurs équivalents grand public. Google Drive fonctionne instantanément, sans configuration, accessible depuis n’importe quel navigateur. Face à ces géants se dressent des solutions aux interfaces parfois moins léchées ou des fonctionnalités moins abouties que les géants technologiques ont depuis longtemps éliminés. Cette barrière technique exclut de facto une large partie de la population, qui n’a ni le temps, ni l’envie, ni les capacités de franchir ce cap. La souveraineté numérique ne peut pas reposer uniquement sur une petite partie d’utilisateurs capables de compiler son propre logiciel. Elle doit devenir accessible au plus grand nombre, ce qui suppose que les outils libres continuent de progresser en ergonomie et en simplicité.

3. L’effet réseau

Le troisième défi est celui de l’effet réseau, un phénomène économique redoutablement efficace. Un service de communication n’a de valeur que si les personnes avec qui vous souhaitez communiquer l’utilisent également. Vous pouvez installer Signal, mais si tous vos amis, votre famille et vos collègues restent sur WhatsApp, vous vous retrouvez isolé. Soit vous les convainquez de migrer, ce qui demande un effort considérable et se heurte souvent à leur inertie, soit vous maintenez les deux applications en parallèle, ce qui annule une partie des bénéfices recherchés. Cet effet réseau constitue un avantage concurrentiel massif pour les acteurs dominants. Chaque nouvel utilisateur renforce la valeur du réseau pour tous les autres, créant une dynamique auto-entretenue qui verrouille le marché. Briser cette logique nécessite soit une migration collective massive,extrêmement difficile à orchestrer, soit l’émergence d’outils interopérables capables de communiquer entre différents réseaux, une piste prometteuse mais encore largement inexploitée.

4. Des business modèles à éprouver

Le quatrième obstacle concerne la viabilité économique des modèles alternatifs. Les services gratuits financés par la publicité ciblée ou la revente de données disposent d’un avantage économique considérable : ils peuvent offrir des produits gratuits, ergonomiques, et constamment améliorés, tout en générant des revenus colossaux.

À l’inverse, les alternatives respectueuses de la vie privée doivent trouver d’autres sources de financement : abonnements payants, dons communautaires, subventions publiques, ou modèles hybrides. Or, convaincre des utilisateurs habitués à la gratuité de payer pour un service équivalent, même plus éthique, reste un défi de taille.

Les projets open source reposent souvent sur le bénévolat de développeurs passionnés, ce qui limite leur capacité à rivaliser avec les équipes professionnelles des géants technologiques. Quelques succès existent : ProtonMail, Tutanota, ou Nextcloud ont réussi à construire des modèles économiques viables, mais ils restent l’exception plutôt que la règle. Trouver des business models pérennes, capables de financer l’innovation et la maintenance à long terme sans compromettre les valeurs de respect de la vie privée, demeure un enjeu crucial pour la démocratisation des alternatives.

5. L’inertie de l’habitude

Enfin, il y a l’inertie de l’habitude, peut-être le plus puissant de tous ces obstacles. Google Drive fonctionne. Gmail fonctionne. WhatsApp fonctionne. Ils sont gratuits, familiers, intégrés dans nos routines quotidiennes. Changer pour une alternative, même objectivement meilleure sur le plan éthique ou sécuritaire, demande un effort conscient. Il faut apprendre une nouvelle interface, transférer ses données, prévenir ses contacts, accepter une période d’adaptation où l’on est moins efficace. Pour la plupart des gens, tant que le service actuel répond à leurs besoins immédiats, l’incitation au changement reste faible. Ce n’est généralement qu’après un scandale de fuite de données, une prise de conscience soudaine, ou une évolution frustrante des conditions d’utilisation que l’idée de migrer devient sérieusement envisagée. Cette inertie comportementale favorise structurellement les acteurs établis et rend la conquête de nouveaux utilisateurs extrêmement difficile pour les alternatives, aussi qualitatives soient-elles.

Pour conclure

Tous ces défis sont réels, parfois décourageants. Ils expliquent pourquoi, malgré des années de scandales (Cambridge Analytica, révélations Snowden, fuites de données à répétition), les géants technologiques conservent leur position dominante.

Mais ils ne sont pas insurmontables. Les pages suivantes vous présenteront des solutions concrètes, accessibles à différents niveaux de compétence et d’engagement, qui permettent de reprendre progressivement le contrôle de votre vie numérique. Car si le chemin vers la souveraineté numérique est semé d’embûches, il reste praticable.

Ce module a été rédigé par deux experts Advens Jérémie Jourdain, Tristan Savalle, et le journaliste chez Numerama Amine Baba Aïssa.

Jérémie Jourdain travaille dans la cybersécurité depuis 25 ans. Après une dizaine d’années passées en consulting et en sécurité offensive, il a rejoint l’équipe des « défenseurs » et posé les bases techniques du SOC Advens. Il encadre les équipes R&D en charge de l’optimisation des techniques de détection et de réaction du SOC. Il accompagne également les équipes R&D de TR-RACING, une écurie engagée dans les courses au large, comme le Vendée-Globe. Promoteur de l’Open-Source, il est impliqué dans plusieurs projets communautaires autour de VultureOS, FreeBSD et rsyslog. Jérémie anime également le volet « Numérique Responsable » chez Advens et est impliqué dans les différents projets du fonds « Advens For People And Planet. »

Tristan Savalle évolue dans le domaine de la cybersécurité depuis près de 30 ans. Ingénieur en réseaux d’entreprise de formation, il découvre la cybersécurité au début des années 2000… et n’en sortira plus. Au fil de son parcours, il a piloté des équipes de consultants en cybersécurité, dirigé des dispositifs de sécurité opérationnelle, conçu des gouvernances SSI dans une recherche de certification ISO 27001 et développé les offres de sécurité d’Advens, notamment dans le secteur de la santé. Il a également défini la stratégie et porté le développement produit des services managés de sécurité mySOC d’Advens. Il occupe aujourd’hui le poste de RSSI d’Advens. Passionné par l’Intelligence Artificielle, il consacre aussi son temps libre à la musique et à la photographie.

Amine Baba Aïssa est responsable de la rubrique Cyberguerre de Numerama. Il a couvert pendant plusieurs années l'actualité internationale pour France 24, il s’est formé à la programmation et à la cybersécurité à l'Ecole 42 afin de vulgariser au mieux les nouveaux enjeux autour des conflits numériques.